Há uma frase que me acompanha há anos neste ofício: "A confiança custa muito para ser construída e muito pouco para ser perdida." Diego Akris, que foi meu Data Lead na Unilever, me disse isso, e desde então não deixei de verificar em cada projeto de dados em que participei.

Trabalhar com dados tem uma particularidade que muitas vezes é subestimada: o que entregamos não é avaliado pelo processo, mas pelo resultado. Ninguém vê as transformações, as validações cruzadas, as horas de limpeza de dados ou a complexidade do modelo que existe por trás. O que veem é um número em uma apresentação, uma métrica em um dashboard, uma conclusão em um relatório.

E eles aceitam como verdade.

Isso nos coloca em uma posição delicada. Porque quando esse número está correto, geramos confiança sem que ninguém perceba. Mas quando falha, mesmo que seja uma única vez, tudo o que fizemos antes é questionado.

O erro técnico que não é apenas técnico

Suponha que um analista apresente um relatório mensal com uma métrica de vendas que não faz sentido. Pode ser um erro de filtro, um join mal feito, uma dimensão temporal mal configurada. Tecnicamente, é um problema menor. Mas para quem recebe esse dado e toma decisões com ele, não é um "erro de filtro". É um dado incorreto. E se já tomou uma decisão com base nisso, o problema escalará rapidamente.

O que o negócio percebe não é "houve um erro no ETL". O que percebe é: "os dados não são confiáveis".

E uma vez que essa percepção se instala, é muito difícil revertê-la.

A analogia da ponte suspensa

Gosto de pensar na confiança com dados como uma ponte suspensa. Cada análise bem feita, cada número validado, cada relatório consistente é uma corda a mais que sustenta a estrutura. Com o tempo, a ponte se torna sólida e as pessoas a cruzam sem pensar.

Mas se uma única corda falha — um único número errado, uma única métrica inconsistente — ninguém quer cruzar. Não importa que as outras noventa e nove estejam perfeitas. A percepção de risco se instala e permanece.

Em dados, reconstruir essa confiança após um erro visível pode levar meses de trabalho impecável. Perder, por outro lado, leva apenas um slide com um número mal colocado.

O que podemos fazer: um framework prático de validação

Após várias experiências próprias e alheias, elaborei uma lista mental que aplico antes de apresentar qualquer análise:

1. Validação cruzada de fontes. Nunca confiar em uma única fonte de dados. Se o número de vendas vem de um sistema, confrontá-lo com outro. Se não houver uma segunda fonte, pelo menos validar em relação a períodos anteriores. O número faz sentido comparado com o mês passado? Com o mesmo mês do ano anterior?

2. Revisar os supostos. Cada análise tem pressupostos implícitos: períodos de tempo, filtros, segmentações, definições de métricas. Antes de apresentar, pergunte-se: o receptor entende esses pressupostos? Estamos medindo o mesmo que eles esperam ver?

3. O teste do "bom senso". Antes de entregar um número, faça a pergunta mais simples: isso faz sentido? Se as vendas cresceram 300% de um mês para outro sem nenhuma campanha especial, provavelmente há um erro. A intuição do negócio é uma ferramenta de validação subestimada.

4. Documentar as definições. Muitos erros de confiança não vêm de dados mal calculados, mas de métricas mal definidas. O que para uma equipe é "usuário ativo" pode ser completamente diferente para outra. Definir claramente o que está sendo medido e como está sendo medido é a base da credibilidade.

5. Ter a humildade de parar. Se algo não faz sentido, não apresente. Parece óbvio, mas a pressão dos prazos muitas vezes empurra a entregar algo "mais ou menos bem" ao invés de esperar e corrigir. A realidade é que esperar um dia e entregar algo sólido gera mais confiança do que entregar rápido e ter que se retratar depois.

A validação não é uma formalidade

Em muitas equipes de dados, a validação é tratada como um passo burocrático. Algo que "temos que fazer" antes de entregar. Mas a validação não é preencher uma lista de verificação apenas para cumprir uma obrigação. É o ato de se colocar no lugar de quem vai receber esse dado e perguntar: que decisão essa pessoa tomará com isso? O que acontece se esse número estiver errado?

Quando pensamos assim, a validação deixa de ser tediosa e se torna estratégica. Porque não estamos validando dados. Estamos protegendo a confiança que nos custou construir.

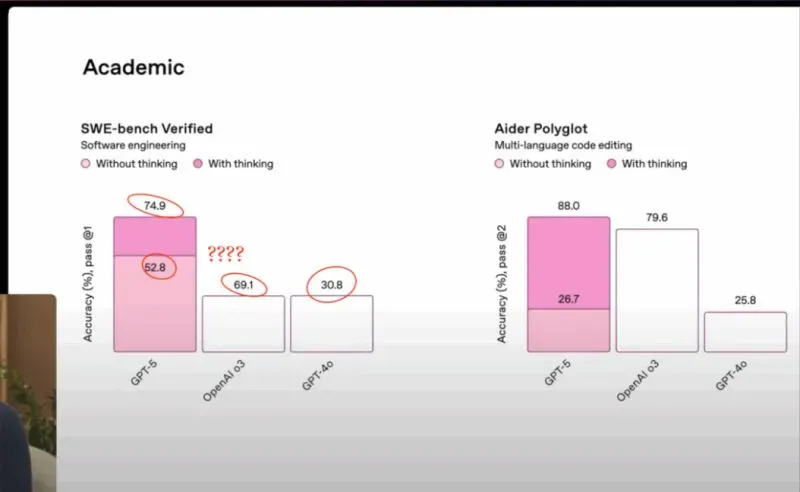

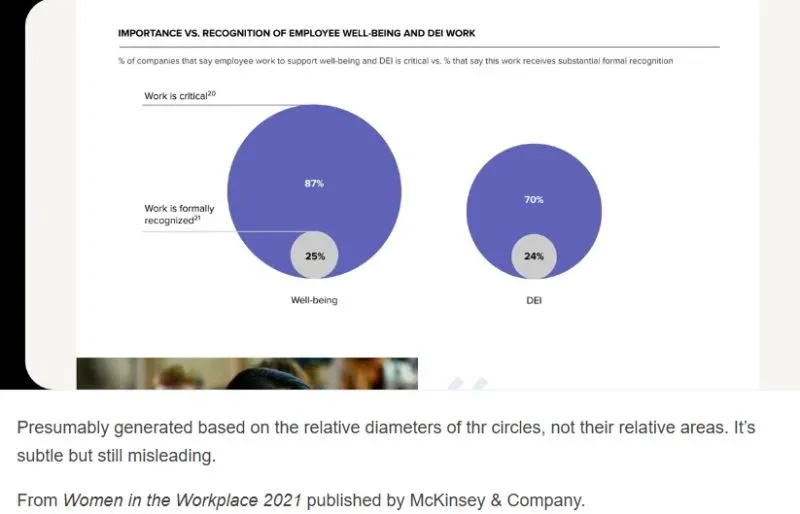

Erros que se tornaram virais

Para dimensionar o impacto real de um erro na visualização de dados, basta percorrer sites como viz.wtf, onde são coletados exemplos de gráficos mal projetados que acabaram se tornando motivo de zombarias nas redes sociais.

Alguns casos que ilustram bem o problema:

Não é necessário que o erro seja catastrófico. Às vezes, um eixo mal escalonado ou uma porcentagem que não soma 100% é suficiente para que a mensagem se perca e a confiança se quebre. Para mais exemplos, recomendo percorrer viz.wtf — é um lembrete constante de por que a validação visual é tão importante quanto a validação técnica.

Reflexão final

No mundo de BI e Analytics, nosso ativo mais valioso não é a ferramenta que usamos nem o modelo que construímos. É a confiança de quem toma decisões com base no que entregamos.

Cada número que apresentamos é uma promessa implícita de que fizemos bem o nosso trabalho. Cuidar dessa promessa, validar com rigor e ter a honestidade de dizer "ainda não está pronto" quando algo não faz sentido, é o que separa um analista que informa de um que influencia.

A confiança é ganha em gramas e perdida em quilos. Vamos nos certificar de somar gramas todos os dias.

Comentários